Source –

Source –

Llama 4 的一个关键概念改进是 MoE 的有效实现。该架构通过仅激活相关专家,显著降低了计算成本。这在增强模型容量的同时,还能保持训练和推理的计算负载可控。

这种效率对于处理日益庞大、高分辨率的多模态数据集和长序列至关重要,否则这些数据集和序列长度会受到传统注意力机制二次扩展的瓶颈限制。这也支持更广泛的可扩展性解决方案,使模型能够从更广泛、更多样化的数据中学习。

凭借 MoE 提供的能力和训练策略的进步,Llama 4 将致力于对图像和文本等不同模态进行更复杂的对齐。这涉及开发更鲁棒的表示,以捕捉特定模态的特征(例如,视觉中的空间相关性、文本中的语义规则),同时实现更深入的跨模态理解和交互。

Llama4 架构还提到了使用早期融合机制 (Early Fusion) 将嵌入对齐到统一的表示空间。虽然这不是其主要目的,但如果使用合适的数据进行训练,MoE 框架内容量的提升和专业化可以间接地帮助更好地处理不同模态之间的统计差异甚至时间差异。

像 Llama 4 这样的模型预计将采用更先进的策略来解决遗传偏差并提高整体鲁棒性。Llama 4 的目标是:

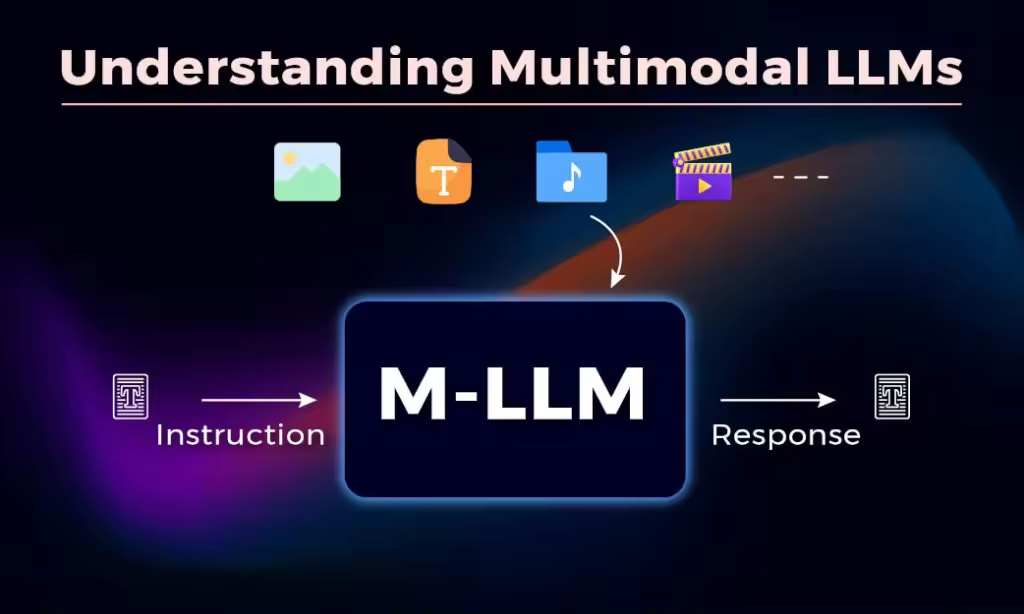

多模态LLM的演进代表了人工智能领域最重要的进步之一,它从根本上改变了机器感知和与周围世界交互的方式。从早期融合和晚期融合的基础概念,到像Llama 4这样的现代系统的复杂架构,我们追溯了使人工智能系统能够以类似人类的复杂度理解和处理多模态信息的技术历程。我们探索的技术基础,包括对比学习原理、联合嵌入空间和对齐机制,提供了使多模态理解成为可能的理论框架。

我们对LLaVA、Llama 3.2 Vision和Llama 4的案例研究展现了多模态能力的快速发展。LLaVA证明了,通过视觉指令调整,优雅的简洁性可以取得显著的效果。Llama 3.2 Vision展示了复杂的交叉注意力机制如何实现鲁棒的多模态推理。Llama 4代表了当前最先进的技术,它引入了混合专家架构和前所未有的上下文长度,从而开辟了全新的应用类别。在本系列的第二部分中,我们将探讨这些多模式 LLM 如何理解音频。

全部评论

留言在赶来的路上...

发表评论