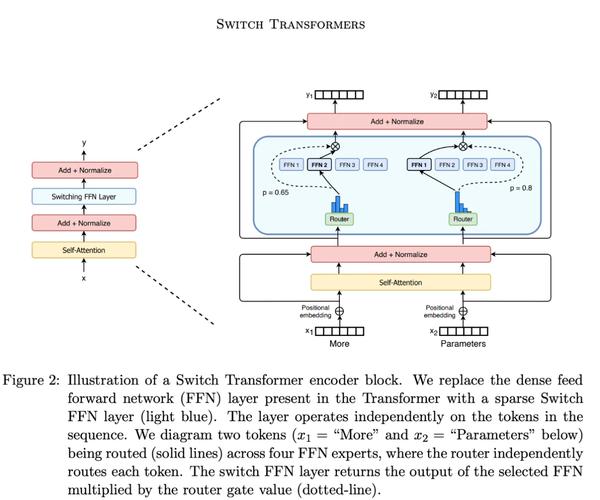

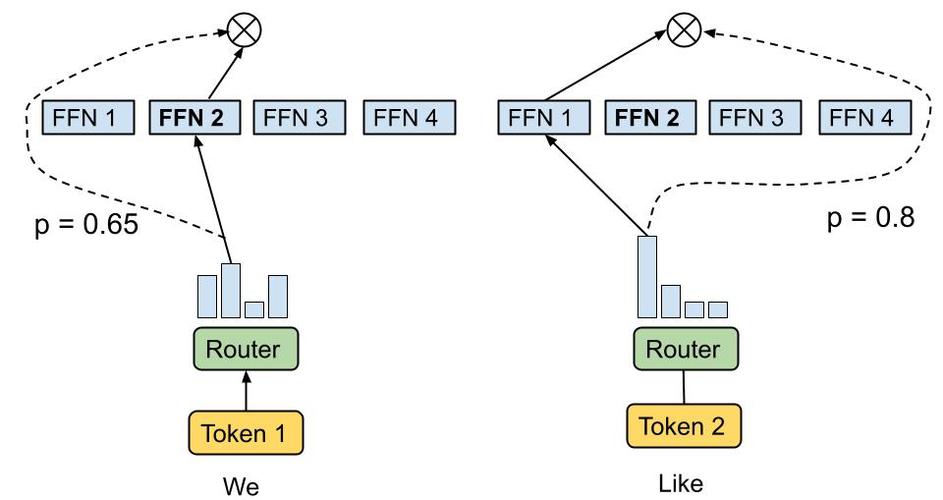

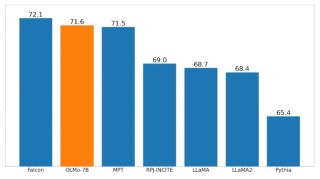

Hunyuan-Large是腾讯推出的大型混合专家(MoE)模型,具有3890亿总参数量和520亿激活参数量,是目前业界参数规模最大的开源MoE模型。基于Transformer架构,支持高达256K的文本序列输入,显著提升长文本任务的处理能力。Hunyuan-Large在长上下文处理、中英文自然语言处理、代码生成、数学运算等9大能力维度上表现出色,超越了Llama3和Mixtral等主流开源模型。Hunyuan-Large采用了高质量合成数据进行训练,通过合成数据增强训练,能学习到更丰富的表示,更好地泛化到未见数据。模型采用分组查询注意力(GQA)和跨层注意力(CLA)策略,减少了KV缓存的内存占用和计算开销,提高了推理吞吐量。

全部评论

留言在赶来的路上...

发表评论