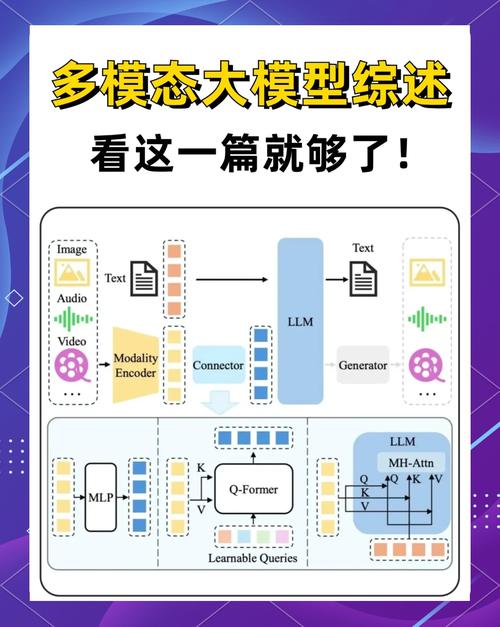

LMMs-Eval 是一个专为多模态AI模型设计的统一评估框架,提供标准化、广泛覆盖且成本效益高的模型性能评估解决方案。包含超过50个任务和10多个模型,通过透明和可复现的评估流程,帮助研究者和开发者全面理解模型能力。LMMs-Eval 还引入了 LMMs-Eval Lite 和 LiveBench,前者通过精简数据集降低评估成本,后者用最新网络信息进行动态评估,以零污染的方式考察模型的泛化能力。为多模态模型的未来发展提供了重要的评估工具。

LMMs-Eval 是一个专为多模态AI模型设计的统一评估框架,提供标准化、广泛覆盖且成本效益高的模型性能评估解决方案。包含超过50个任务和10多个模型,通过透明和可复现的评估流程,帮助研究者和开发者全面理解模型能力。LMMs-Eval 还引入了 LMMs-Eval Lite 和 LiveBench,前者通过精简数据集降低评估成本,后者用最新网络信息进行动态评估,以零污染的方式考察模型的泛化能力。为多模态模型的未来发展提供了重要的评估工具。

全部评论

留言在赶来的路上...

发表评论