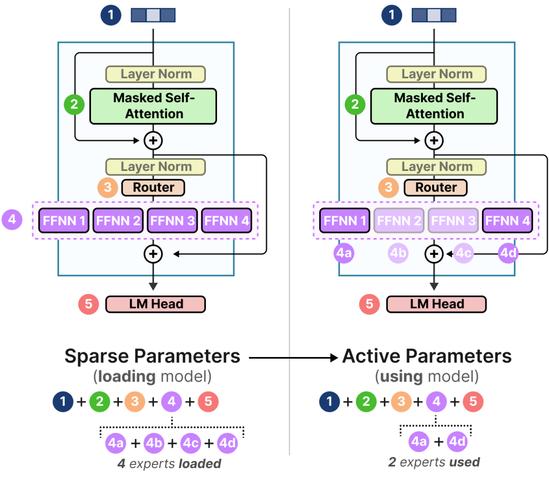

Time-MoE是创新的时间序列基础模型,基于混合专家(Mixture of Experts, MoE)架构,将时间序列预训练模型的参数规模扩展至十亿级别。模型用稀疏激活机制,在预测任务中仅激活部分网络节点,有效提升计算效率,降低计算成本。Time-MoE模型支持任意长度的输入和输出范围,能处理从短期到长期的各种时序预测任务。模型在新引入的大规模数据集Time-300B上进行预训练,包含超过3000亿个时间点,覆盖9个以上领域,是目前最大的公开时间序列数据集,为模型训练提供丰富的多领域数据,确保其在多种任务中的卓越泛化能力。

全部评论

留言在赶来的路上...

发表评论