99%的人都理解错了,AI Agent ≠ Agentic AI,康奈尔大学发33页论文澄清关键区别。

TL;DR:如果您有一个AI产品,用户问您这是AI Agent还是Agentic AI?如果您回答不出来,或者认为这两个概念是一回事,那您可能需要重新审视自己的技术认知了。不过没关系,因为99%的人都不知道,现在您只需要看完这篇文章就可以了。

康奈尔大学最新发布的33页论文揭示了一个被99%开发者忽视的真相:AI Agent和Agentic AI本质上是两个完全不同的技术范式,混淆它们可能让你的产品开发走向错误的方向。

📊 27个要点速览: AI Agent vs Agentic AI

- 现在的大多数 AI 工具只擅长做一件事。这就是一个 AI Agent。

- 未来属于那些能思考、规划和协作的系统。那是 Agentic AI。

- AI Agent 是执行者。Agentic AI 是决策者。

- AI Agent 遵循规则。Agentic AI 能即兴制定新规则。

- 一个是单兵作战。另一个是多个 AI 协作的团队。

- AI Agent 可以帮你回复邮件。Agentic AI 能运营你的研究实验室。

- Agentic AI 利用记忆、规划和协作来应对混乱局面。

- 想象 10 个 AI,各自有角色,协作成团队。这就是 Agentic AI。

- AI Agent 专注任务。Agentic AI 专注结果。

- AI Agent 容易陷入循环。Agentic AI 会适应并继续前行。

- 情境变化时,AI Agent 会崩溃。Agentic AI 会重新规划。

- 没有记忆,AI 无法扩展。Agentic AI 解决了这个问题。

- 关键在于编排 AI Agent 协作而不混乱。

- 无论是供应链、医院还是游戏引擎,Agentic AI 都适用。

- 聊天机器人不是智能系统。这正是误区所在。

- 真正的智能来源于协调,而不仅是生成。

- 长期可靠性需要记忆、反应和协作。

- Agentic AI 使用反馈回路:行动 → 观察 → 调整。

- AI Agent 在脱离上下文时会“幻觉”。Agentic AI 会从错误中学习。

- 管理 Agentic AI 需要治理体系,而不是只靠提示词。

- 最大挑战是协作但不混乱。

- 当你的 AI 团队自相矛盾时,系统就会崩溃。

- Agentic AI 需要透明性、可追溯性和强规则。

- 工具使用还不够,系统必须选择正确的工具。

- RAG、ReAct、记忆层——这些是真正的构建模块,不是流行词。

- 当下大多数初创公司仍在构建 AI Agent。

- 别只构建一个聪明的智能体,去构建一个聪明的系统。

🎯 为什么这个区别如此重要?

⚡ ChatGPT时代的技术分水岭

2022年11月ChatGPT发布后,AI领域进入了一个全新的发展阶段,但大多数人只看到了表面的聊天能力提升。

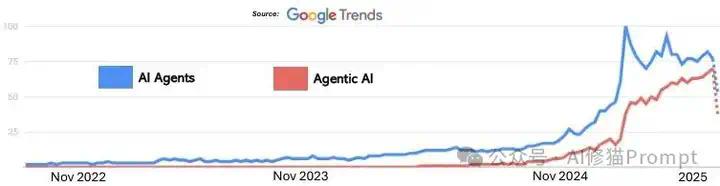

研究者通过Google Trends数据发现:

- "AI Agents"和"Agentic AI"的搜索量在这个时间点后呈现爆发式增长

- 令人担忧的是,绝大多数开发者并不清楚这两个概念的根本差异

- 这种认知混乱不仅影响技术选型,更可能导致整个产品架构设计的偏差

📈自2022年11月ChatGPT时代以来,"AI Agents"和"Agentic AI"全球搜索兴趣的急剧上升趋势

🎯 技术演进的三个关键阶段

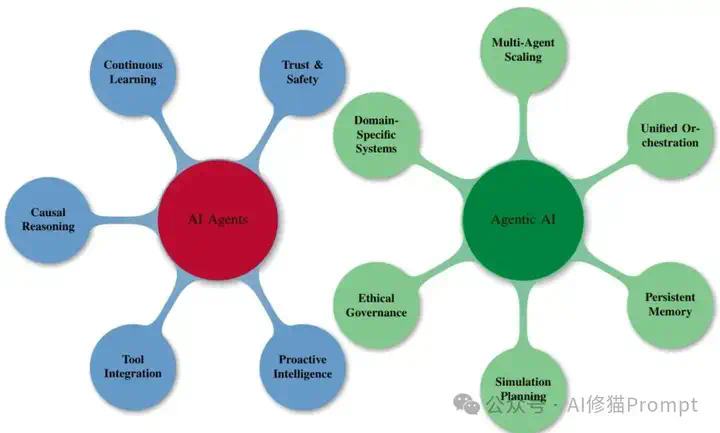

论文明确指出,从生成式AI到真正的智能代理系统,存在三个清晰的演进层次:

- 🔸 Generative AI:我们熟悉的ChatGPT基础版本,只能进行prompt-response的简单对话

- 🔹 AI Agent:能够调用外部工具完成特定任务,比如查询天气、发送邮件

- 🔶 Agentic AI:多个智能代理协同工作的复杂系统,能够自主分解任务、动态协调、持续学习

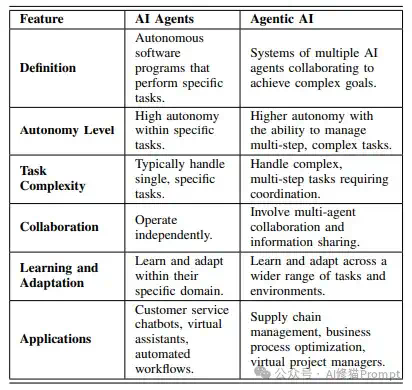

核心功能对比表

🧠 差异:

AI Agents 是能够独立执行特定任务的自主软件程序,具有较高的任务自主性,但通常只处理单一任务,且缺乏与其他代理的协作能力。它们的学习和适应能力局限于特定领域,主要用于客服机器人、虚拟助手等场景。

Agentic AI 则代表一种由多个AI代理组成的系统,这些代理可以协同工作,解决复杂的多步骤任务。它不仅拥有更高层次的自主性,还能在多个任务和环境中进行学习与适应。其典型应用包括供应链管理、流程优化和虚拟项目管理,体现出系统级的智能协作与协调能力。

这种演进标志着从“功能性智能”向“系统性智能”的跃迁。

AI Agent:「智能」其实很有限

单兵作战的工具调用者

AI Agent本质上是一个增强版的LLM,它的核心能力是将语言模型与外部工具连接起来。可以这么理解,你开发的客服机器人能够查询订单状态、检索产品信息、生成回复,这就是典型的AI Agent。它遵循"感知-推理-行动"的简单循环,当用户询问"我的订单在哪里"时,Agent会调用订单查询API,获取结果后生成回复。这个过程虽然看起来智能,但实际上是预定义的工具调用序列,缺乏真正的自主性和创造性。

🔧 主流开发框架:从理论到实践

如果你想立即上手开发AI Agent,目前市场上有从重量级到轻量级的多种选择:

🏗️ 企业级重量级框架

🟦 LangChain - 最受欢迎的选择

- 提供完整的工具链:提示模板 → 记忆管理 → 工具调用 → 输出解析

- 几十行代码就能构建智能助手(搜索网络、查询数据库、执行计算)

- 特点:功能全面,但体积较大(405K行代码,166MB+)

🟨 ReAct框架 - 推理行动循环

- 实现"推理-行动-观察"的循环机制

- 让Agent能够像人类一样思考再行动

- 在复杂问题解决中表现出色

🟩 AutoGPT - 自主执行能力

- 展示AI Agent的自主执行能力

- 分解高级目标为具体任务

- 自动调用各种工具完成复杂工作流程

这种从重量级到轻量级的选择体现了AI Agent开发生态的多样性,开发者可以根据项目需求、团队技能和维护成本来选择合适的框架。

商业级产品的技术实现

研究者详细分析了当前已投入商用的AI Agent产品,为开发者提供了宝贵的参考。OpenAI的Deep Research Mode代表了单Agent系统的高级形态,它能够自主进行多轮资料搜集、交叉验证、深度分析,一次研究任务可以处理数百个信息源。Google的NotebookLM Plus展示了知识管理Agent的可能性,能够跨Google Workspace应用进行信息整合和检索。Amazon的Nova Act在工作流自动化方面取得突破,能够理解复杂的自然语言指令,跨多个应用程序执行操作序列。这些产品的共同特点是都基于大型语言模型,通过工具调用扩展能力,但仍然是单一Agent的架构模式。

🏗️ 架构特点:模块化但孤立

研究者发现,AI Agent的架构包含四个核心模块:

- 🧠 感知模块:负责处理用户输入

- ⚡ 推理模块:基于LLM进行决策

- 🎯 行动模块:执行具体操作

- 📚 学习模块:进行简单的反馈调整

✅ 优势:简单可控,每个模块职责清晰,便于调试和维护

❌ 问题:这种架构本质上是孤立的,Agent无法与其他Agent有效协作,也无法处理需要长期规划的复杂任务

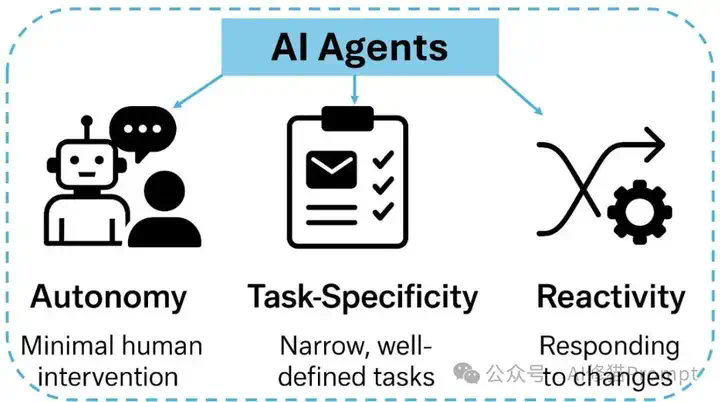

🎯 AI Agent的三大核心特征——自主性、任务专一性和反应性,这些特征决定了其设计理念和运行机制

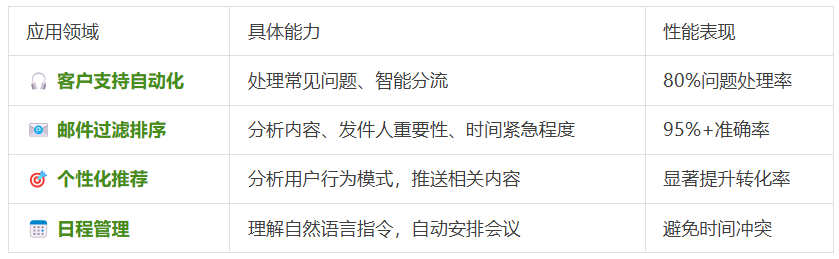

📋 应用场景:擅长但受限

AI Agent在特定场景下表现出色,论文总结了四个主要应用领域:

🌟 Agentic AI:真正的智能涌现

🤝 多代理协作的复杂系统

如果说AI Agent是一个聪明的工具使用者,那么Agentic AI就是一个智能的团队。

举个例子:想象你要开发一个自动化的软件开发系统

- 单个AI Agent:可能只能完成代码生成或测试中的一个环节

- Agentic AI系统:可以让多个专业Agent协作完成整个开发流程

🎭 角色分工:

- 产品经理Agent → 分析需求

- 架构师Agent → 设计系统

- 程序员Agent → 编写代码

- 测试工程师Agent → 进行验证

- 项目经理Agent → 协调进度

每个Agent都有专门的角色和能力,它们通过结构化的通信协议进行协作,形成了一个真正的"AI团队"。

🚀 前沿框架:协作智能的技术实现

🥉 ChatDev - 敏捷开发模式

- 专注于敏捷开发模式

- Agent们在虚拟会议室中讨论、决策、执行任务

- 更注重团队协作的动态性

🥉 AutoGen - 通用协作框架

- 提供更通用的多Agent对话框架

- 支持人类与AI Agent、AI Agent之间的复杂交互

- 特别适合需要人机协作的场景

🏢 商业应用的突破性案例

在实际商业环境中,Agentic AI已经开始展现出惊人的能力:

💼 Salesforce Einstein Copilot - 客户服务全流程自动化

- 能力:问题分类 → 解决方案推荐 → 后续跟进

- 特点:多个专业Agent协作处理复杂客户问题

📊 Microsoft Copilot Studio - 生产力工具集成

- 覆盖:Word、Excel、PowerPoint、Teams等应用协调工作

- 实现:文档管理、会议安排、项目跟进的一体化自动化

🔧 Atera AI Copilot - IT运维专业化

- 团队:诊断Agent + 修复Agent + 监控Agent

- 成果:故障的自动发现、分析和解决

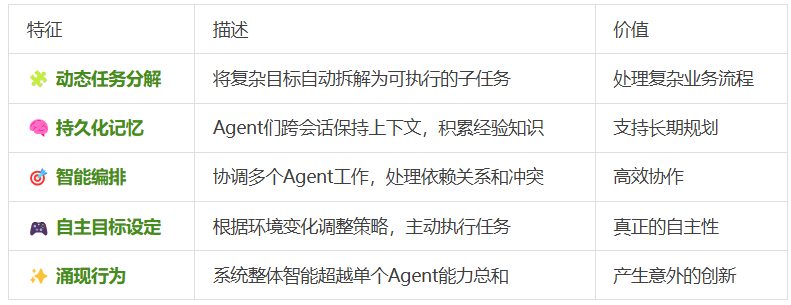

⭐ 核心特征:涌现智能

Agentic AI的威力来源于五个关键特征:

📊 自主性与交互能力对比表

🚀 不知道选择什么?先从PocketFlow开始

如果你对AI Agent vs Agentic AI的选择感到困惑,或者想要快速理解两者的实际差异,PocketFlow是一个理想的起点。作为100行极简框架,它既能构建简单的AI Agent,也能构建复杂的Agentic AI系统,让你在同一个框架内体验两种技术路径的差异。具体您可以看下这篇《被LangChain折磨够了吗?试下100行代码打造的LLM有向图框架PocketFlow | 最新》和《用PocketFlow为Github庞大代码库自动生成教程,一次性彻底搞懂庞大项目!| 最新》

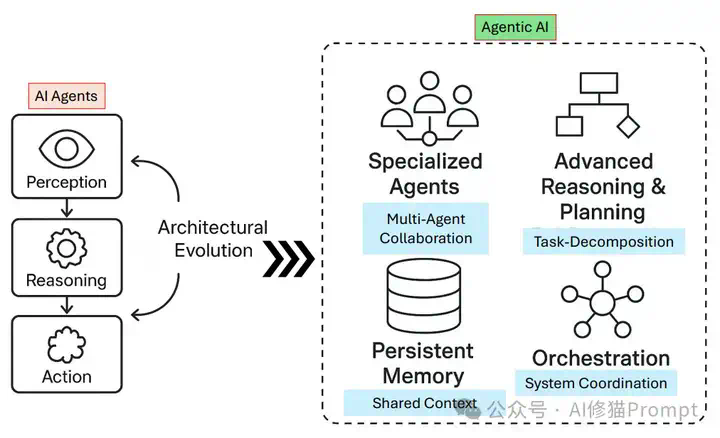

🔄 架构演进:从集中到分布

研究者通过详细的架构对比分析,揭示了Agentic AI相对于AI Agent的根本性提升:

🏗️ 架构模式对比

从传统AI Agent到Agentic AI的架构演进路径。展示了从感知-推理-行动的简单循环,发展为包含专业化Agent、高级推理规划、持久化记忆和编排机制的复杂分布式系统

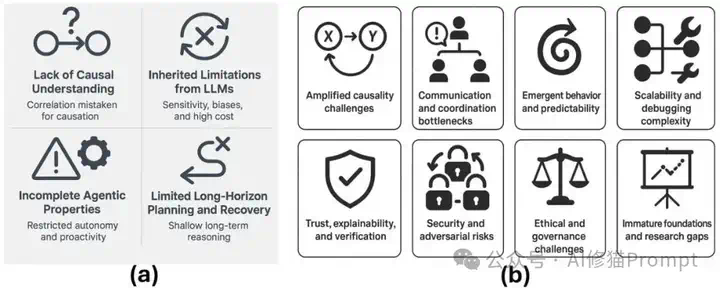

⚠️ 技术挑战:现实很骨感

🚫 AI Agent面临的四大难题

🧠 缺乏因果理解 - 最根本的问题

- 问题:Agent只能识别统计相关性,无法建立真正的因果关系

- 举例:可能学会"医院附近的人更容易生病"这种错误关联

- 本质:无法理解是因为生病才去医院

🤖 LLM固有限制

- 幻觉问题:生成不准确信息

- 提示敏感性:对输入格式过于敏感

- 推理浅层化:缺乏深度逻辑推理能力

- 放大效应:这些问题在Agent系统中会被放大

⚡ 有限的Agent特性

现有系统在以下方面远未达到理论要求:

- ❌ 自主性不足:仍需大量人工干预

- ❌ 主动性缺乏:被动响应而非主动发现问题

- ❌ 社交能力弱:难以理解复杂的人际交互

📅 长期规划能力不足

- 限制:难以处理需要多步骤、长时间跨度的复杂任务

- 表现:无法进行战略性思考和规划

⚖️ AI Agent与Agentic AI的技术挑战对比。(a)AI Agent面临的四大核心限制;(b)Agentic AI面临的八重复杂挑战,包括协调瓶颈、错误级联、涌现行为不可预测等

🌪️ Agentic AI的八重困境

🔗 因果性挑战升级

- 问题:一个Agent的错误推理可能引发连锁反应

- 后果:导致整个系统偏离正确轨道

📡 通信协调瓶颈

- 核心障碍:Agent间需要建立共同的语义理解和通信协议

- 现状问题:大多数系统仍依赖自然语言交流,效率低且容易产生歧义

🎲 涌现行为的双面性

- 积极面:带来了预期之外的智能表现

- 消极面:产生设计者未曾预料的行为模式,不可预测性增加

📈 可扩展性问题

- 表现:Agent数量增加时,调试复杂度呈指数级增长

- 挑战:系统管理和维护难度急剧上升

🔍 其他关键挑战

- 错误级联传播:单点故障影响整个系统

- 资源竞争冲突:多Agent争夺有限资源

- 一致性维护困难:保证系统状态一致性

- 性能监控复杂:难以定位问题源头

🛡️ 信任与安全的双重考验

❓ 可解释性缺失

- 问题:制约Agentic AI商业化的关键因素

- 难点:多Agent协作产生结果时,很难追溯决策的具体来源和逻辑链条

🔒 安全风险放大

- 特点:在分布式架构中被放大

- 风险:单个Agent被攻击可能影响整个系统的安全性

⚖️ 伦理治理挑战

涉及多个复杂层面:

- 责任归属:出错时如何确定责任主体

- 偏见传播:Agent间偏见的传播和放大

- 价值对齐:确保系统行为符合人类价值观

- 治理困境:现有单模型伦理框架无法直接适用于多Agent系统

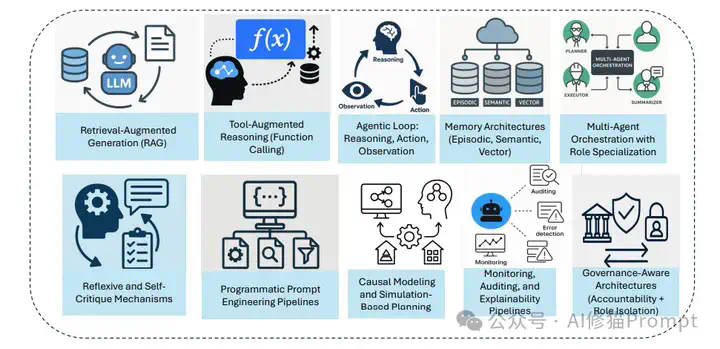

🛡️ 十大解决方案:技术突围之路

面对AI Agent和Agentic AI的技术挑战,康奈尔大学的研究者提出了10种系统性解决策略。这些方案不是孤立的技术补丁,而是构成了一个完整的技术栈,从基础能力增强到高级协作机制,从监控治理到伦理合规,为构建可信、可扩展的智能代理系统提供了全方位的技术路径。

1️⃣ 检索增强生成(RAG - Retrieval-Augmented Generation)

🎯 核心功能:通过向量数据库检索实时数据,将外部知识融入生成过程,有效减少幻觉问题

🔧 技术实现:LlamaIndex、Chroma、Pinecone、Weaviate等提供专业的文档处理和向量检索能力

💎 应用价值:为Agentic AI提供共享的真实性基础,减少多Agent间信息不一致《RAG发展图谱:从基础检索到记忆增强,再到自适应RAG的五大范式 | RAG最新综述》

2️⃣ 工具增强推理(Tool-Augmented Reasoning/Function Calling)

🎯 核心功能:让Agent能够调用外部工具和API,从静态预测器转换为交互式问题解决器

🔧 技术实现:OpenAI Function Calling、Anthropic Tool Use、Google Function Calling等标准化接口

💎 应用价值:大幅扩展Agent与现实世界系统的交互能力,提升问题解决效率

3️⃣ Agent循环机制(Agentic Loop: Reasoning, Action, Observation)

🎯 核心功能:基于ReAct框架的"推理-行动-观察"迭代循环,形成深思熟虑的决策过程

🔧 技术实现:ReAct、SelfAsk、Chain-of-Thought等多种推理模式框架

💎 应用价值:支持复杂问题的分步解决,提升决策质量和可解释性

4️⃣ 记忆架构(Memory Architectures)

🎯 核心功能:包含情景记忆、语义记忆、向量记忆三层体系,为Agent提供类人记忆能力

🔧 技术实现:MemGPT操作系统级内存管理、Zep专业记忆服务、向量数据库持久化存储

💎 应用价值:支持长期规划、跨会话学习和上下文连续性

5️⃣ 多Agent编排与角色专业化(Multi-Agent Orchestration)

🎯 核心功能:通过元Agent或调度器实现专业化分工和高效协作

🔧 技术实现:ChatDev、AutoGen、CrewAI等多Agent协作框架

💎 应用价值:增强系统可扩展性、可解释性和故障隔离能力

6️⃣ 反思与自我批评机制(Reflexive and Self-Critique)

🎯 核心功能:Agent能够评估自己的输出质量,通过自我批评和改进提升性能

🔧 技术实现:Constitutional AI、Self-Critique、Reflexion等反思框架

💎 应用价值:提高系统鲁棒性,支持协作质量控制和迭代改进

7️⃣ 程序化提示工程(Programmatic Prompt Engineering)

🎯 核心功能:通过模板化和自动化解决手工提示调优的脆弱性问题

🔧 技术实现:PromptFlow、LangSmith等平台提供模板管理、版本控制、性能监控

💎 应用价值:确保Agent间通信一致性,防止协调偏移和提示依赖问题

8️⃣ 因果建模与仿真规划(Causal Modeling and Simulation-Based Planning)

🎯 核心功能:为Agent提供因果推理能力,能够预测行动后果并制定更好策略

🔧 技术实现:STRIPS、PDDL规划语言,贝叶斯推理层,仿真环境框架

💎 应用价值:解决统计相关性与因果关系混淆问题,支持战略决策和风险评估

9️⃣ 监控审计与可解释性(Monitoring, Auditing, and Explainability)

🎯 核心功能:记录所有Agent行为轨迹,提供完整的审计日志和可解释性分析

🔧 技术实现:LangSmith行为追踪、Weights & Biases性能监控、可视化分析工具

💎 应用价值:支持系统调优、问题诊断、合规检查和责任追溯

🔟 治理感知架构(Governance-Aware Architectures)

🎯 核心功能:通过角色隔离、权限控制、审计追踪确保系统安全性和合规性

🔧 技术实现:Guardrails AI安全过滤、IBM watsonx.governance、Microsoft Azure AI Content Safety

💎 应用价值:确保Agent在权限范围内行动,决策可审计可撤销,满足企业级安全要求

💡 关键洞察:这10种解决策略构成了一个层次化的技术体系,从底层的RAG和工具调用,到中层的记忆管理和Agent协作,再到顶层的监控治理和伦理合规,为开发者提供了构建下一代智能代理系统的完整技术路线图。

💼 给开发者的实践建议

🎯 技术选型的决策框架

选择AI Agent的情况:

✅ 产品需求相对简单(客服聊天、内容推荐、简单自动化)

✅ 用户交互模式固定

✅ 对成本敏感

✅ 开发周期要求短

选择Agentic AI的情况:

✅ 复杂的多步骤任务

✅ 需要多个专业能力的协作

✅ 希望系统具备自主学习和适应能力

✅ 对智能性要求很高

🏗️ 架构设计的关键考量

AI Agent路径:

- 🔧 重点关注工具集成、提示工程、错误处理机制的设计

- 📊 注重单Agent性能优化和响应速度

- 🛡️ 简化安全和监控机制

Agentic AI路径:

- 🤝 投入更多精力在Agent间通信协议设计

- 📋 重点设计任务分解策略和协调机制

- 🔍 建立完善的监控、审计、安全体系

⚠️ 重要提醒:无论选择哪条路径,都要充分考虑监控、审计、安全等方面的需求,为未来的扩展和优化留下空间。

🚫 避免常见的技术陷阱

❌ 避免盲目追求先进

不要为了追求技术先进性而盲目选择Agentic AI,复杂度的增加往往带来维护成本的指数级上升。

❌ 不要忽视数据质量

不要忽视数据质量和标注的重要性,再先进的架构也无法弥补数据层面的缺陷。

❌ 不要低估安全问题

不要低估安全和伦理问题的复杂性,这些问题在多Agent系统中会被显著放大。

✅ 推荐的实践路径

- 从简单开始:先用AI Agent验证核心业务逻辑

- 渐进升级:根据实际需求逐步向Agentic AI演进

- 重视监控:从一开始就建立完善的监控和审计机制

- 关注安全:将安全和伦理考虑融入设计的每个环节

🗺️ AI Agent和Agentic AI的未来发展路线图。左侧展示AI Agent向主动智能、工具集成、因果推理、持续学习和信任安全五个方向演进;右侧展示Agentic AI向多Agent扩展、统一编排、持久记忆、仿真规划、伦理治理和领域专业化发展

🎯 未来已来,你准备好了吗?

康奈尔大学的这篇论文为我们澄清了AI Agent和Agentic AI的本质区别。

作为开发者,我们需要:

- 📝 明确定位:根据实际需求选择合适的技术路径

- ⚖️ 平衡考量:既不能保守错失机会,也不能激进增加不必要的复杂性

- 🔮 前瞻思考:为技术演进和系统升级做好准备

🌟 核心观点:未来的AI世界将同时需要高效的AI Agent和协作的Agentic AI,关键是在正确的场景选择正确的技术。

技术的进步永不停歇,但理解技术的本质更加重要。 当你下次面对AI Agent和Agentic AI的选择时,我相信或许你已经有了答案。

📚 本文基于康奈尔大学33页论文《AI Agents vs. Agentic AI: A Conceptual Taxonomy, Applications and Challenges》分析整理

文章来自于“AI修猫Prompt”,作者“AI修猫Prompt”。

全部评论

留言在赶来的路上...

发表评论