为避免向模型输入嘈杂、过长的样本而影响学习,DeepCoder 采用了超长过滤技术,该技术的灵感来自 DAPO。这将过滤掉超过最佳长度的训练样本,有助于保持模型学习内容的清晰度。

这些策略共同确保了模型不仅能成长,还能变得更聪明。

面对现实吧–互联网上的数据集编码是一团糟!无论是从 GitHub、在线评委还是论坛上抓取的数据集,通常都是不完整、有漏洞或不一致的。这对强化学习(RL)来说是个问题,因为强化学习依赖于可验证的、一致的奖励信号。

为了解决这个问题,AgenticAI 团队建立了一个定制的数据整理管道,重点包括

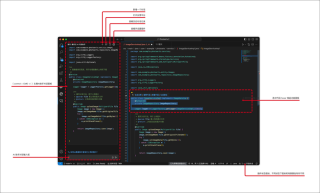

下面的代码显示了其数据处理管道中使用的核心验证逻辑。该功能根据质量标准对每个问题进行检查,然后才允许其进入数据集:

这样就产生了一个包含 24,000 个编码问题的干净、可验证的数据集,非常适合 RL 微调。这种细致的过滤确保了训练过程中的奖励能够真正反映正确性,而不是偶然性或过度拟合。

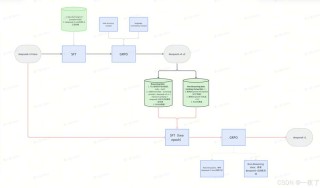

评估代码不同于评估文本。您不能仅仅比较标记的相似性–您需要运行代码并测试其输出,最好是在边缘情况下测试数千次。这就是 DeepCoder 的开源 RL 引擎 rLLM 的用武之地。

以下是 rLLM 脱颖而出的原因:

这种基础设施不仅速度快,而且使大规模、可验证的 RL 培训变得切实可行。没有手忙脚乱,没有近似值;真实的代码、真实的测试、真实的结果。

想试试吗?请访问代码仓库:

这样就产生了一个包含 24,000 个编码问题的干净、可验证的数据集,非常适合 RL 微调。这种细致的过滤确保了训练过程中的奖励能够真正反映正确性,而不是偶然性或过度拟合。

虽然 DeepCoder 的性能指标令人印象深刻,但它对人工智能社区的真正价值在于其可访问性和可重复性。本节将介绍使用这一创新模型的实际操作,从初始设置到高级训练配置。

DeepCoder 的开发团队针对 Python 3.10 对代码库进行了优化,确保稳定性的同时充分利用现代语言的特性。安装过程从创建专用的 Conda 环境开始:

导航到 rllm 目录后,你需要安装 verl 强化学习框架和主要包:

这种安装模式反映了模块化架构,verl 作为专门的 DeepCoder-14B 强化学习引擎,为其令人印象深刻的代码生成能力提供动力。

DeepCoder 的优势之一在于其精心策划的数据集。存储库既提供原始训练数据,也提供预处理脚本,以便将其转换为优化的训练格式。

要开始使用这些数据,请:

这些预处理步骤实施了前面提到的严格数据质量控制,确保所有代码示例符合 DeepCoder-14B 强化学习的严格要求。

DeepCoder 灵活的训练架构可容纳各种计算资源,使其既适用于个人研究人员,也适用于拥有大量基础设施的大型团队。

能够使用单台高性能机器的研究人员可以从以下方面开始训练:

这种单节点配置为试验框架或针对特定领域进行微调提供了一个绝佳的切入点。

DeepCoder 的分布式训练功能可让大型实验受益匪浅。该配置使用 Ray 来协调多台机器上的训练:

这种可扩展的方法有助于实现 DeepCoder 的突破性性能,使团队能够有效地在更长的上下文长度和更大的数据集上进行训练。

DeepCoder 的性能声明由一个全面的评估框架提供支持,该框架可自动运行多个 vLLM 实例来测试模型的能力:

这种评估方法与 LiveCodeBench 方法如出一辙,可确保报告的指标准确反映具有挑战性的编码任务的实际性能。

在本节中,我们将探讨 DeepCoder-14B 能否以清晰和初学者友好的方式解释基本编程概念。

任务:解释编程概念

让我们使用 DeepCoder-14B 来解释哈希表的工作原理,并看看它能否生成一个 Python 示例。

代码:

点评:

DeepCoder-14B 对散列表的功能进行了深思熟虑、循序渐进的概念分解,令人印象深刻。以下是其中的亮点:

推理性能说明:虽然模型输出的概念性很强,但延迟却非常高(总耗时约 11 分钟),这表明 DeepCoder-14B 可能最适合内容生成、辅导或文档等非实时应用。

在本节中,我们将比较 DeepCoder-14B 与 OpenAI 的 o1 和 03-mini 在代码生成和错误修复这两项常见编程任务中的表现。我们将给 DeepCoder-14B、o3-mini(用 Phi-2 模拟)和 o1(用 LLaMA-2 7B 模拟)分配同样的两项任务,看看模型的大小和设计如何影响代码质量、解释深度和推理能力。从生成一个简单函数到识别递归代码中的逻辑错误,这种比较将让我们更清楚地了解大型模型的真正优势和小型模型的优势。

让我们使用 DeepCoder-14B 生成一个查找 1 到 100 之间所有素数的 Python 函数,并将其响应与 o3-mini 进行比较。

DeepCoder-14B 生成代码:

Phi-2 (Simulating o3-mini) 生成代码:

评价:

DeepCoder-14B 深入浅出、循序渐进地剖析了寻找质数背后的逻辑,模仿了初学者推理问题的方式。虽然它很有见地,但并不返回实际代码,这限制了它在直接执行方面的实用性。相比之下,Phi-2 (o3-mini) 不需要任何解释,就能提供一个简洁、正确的 Python 函数,快速、高效,随时可以运行。DeepCoder 更适合深度教学,而 Phi-2 则更擅长实用的编码速度和清晰度。

现在,让我们用一项经典的调试任务来挑战 DeepCoder-14B。我们将向它提供一个有错误的递归阶乘函数,要求它修复代码并解释出错的原因。然后,我们将把同样的任务交给 OpenAI 的 o1 模型(由 LLaMA-27B 模拟),并比较它们的反应。

错误代码:

DeepCoder-14B:

LLaMA-2 7B (simulating o1):

点评:

在这个任务中,DeepCoder-14B 和 o1(LLaMA-2 7B)都正确地发现了阶乘函数中的错误–认识到基例应该返回 1 而不是 0。DeepCoder-14B 通过逻辑推理,强调了错误的基例如何导致错误的结果,特别是 n=1 时,表现出很强的推理能力。

然而,它的输出存在一个关键缺陷:重复循环“Wait, no”,这降低了可读性,并使响应感觉不稳定。相比之下,o1 的响应简洁、干净、正确,通常包括固定代码和简要解释。虽然没有 DeepCoder 的推理深度,但 o1 的可靠性和清晰度使其更适合实际使用,尤其是在部署或教育环境中。

虽然目前的成果主要集中在编码方面,但该团队计划

这一版本标志着向高级人工智能编码工具民主化迈出了重要一步,它为研究人员和开发人员提供了

该模型的麻省理工学院许可证确保了商业和研究使用不受限制,促进了整个人工智能生态系统的创新。DeepCoder-14B 兼具极具竞争力的性能和完全的透明度,为开源人工智能编码模型的开发确立了新的标准。

DeepCoder 的一切都围绕着透明度和社区展开:

这使得它成为以下人员的绝佳资源

在这个由封闭墙和黑盒模型主导的时代,DeepCoder-14B 是一股新鲜空气。它表明,开源人工智能编码模型可以扩展、竞争和创新,而无需躲在应用程序接口或付费墙后面。从上下文扩展到数学泛化,从经过验证的数据集到高速沙盒,DeepCoder 的一切都让人感到深思熟虑、用心良苦、社区至上。

希望改进编码工作流程的开发人员可以立即开始使用 DeepCoder。该模型在竞赛级编码任务上的出色表现使其适用于从自动代码补全到算法问题解决等各种应用。如果您正在构建人工智能辅助开发的未来,DeepCoder-14B 不仅值得一试,还可能成为您的新基准。

全部评论

留言在赶来的路上...

发表评论