小样本学习(FSL),在少数资料中也被称为低量学习(LSL),是一种机器学习方法,训练数据集包含有限的信息。

机器学习应用的通常做法是提供模型所能接受的尽可能多的数据。这是因为在大多数机器学习应用中,提供更多的数据可以使模型预测得更好。然而,少数几个镜头的学习旨在用较少的训练数据建立准确的机器学习模型。

小样本学习算法加上以数据为中心的模型开发方法可以帮助公司减少数据分析/机器学习(ML)成本,因为输入数据量是决定资源成本(如时间和计算)的一个重要因素。

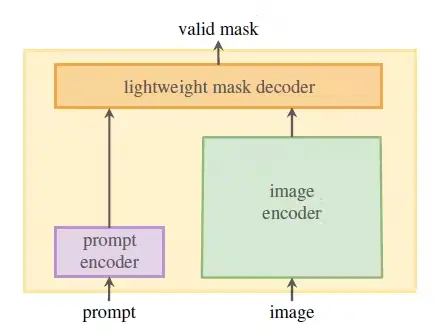

1. 计算机视觉:计算机视觉探讨了计算机如何从数字图像或视频中获得高水平的理解。小样本学习主要用于计算机视觉,以处理以下问题:

2. 自然语言处理(NLP):小样本学习使应用程序能够用少量的文本数据实例完成任务。这些任务可以列举如下:

3. 音频处理:含有语音/声音信息的数据可以通过声学信号处理进行分析,小样本学习可以实现以下任务的部署:

4. 机器人技术:为了使机器人的行为更像人类,它们应该能够从少数示范中概括出信息。因此,在训练机器人完成某些任务的过程中,少数几个镜头的学习起着关键作用,例如:

5. 医疗保健:

6. 其他应用:

Source:

Source:

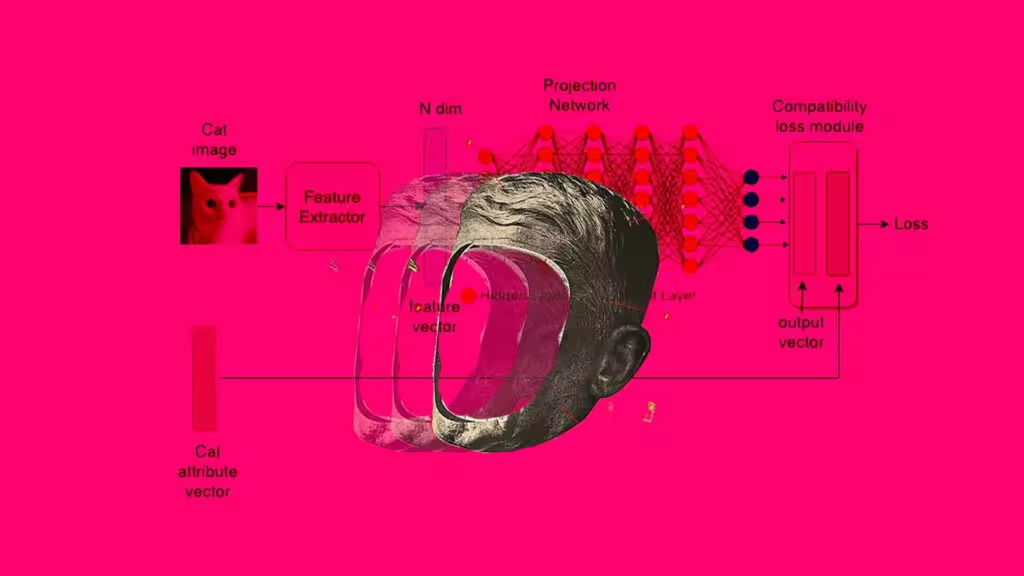

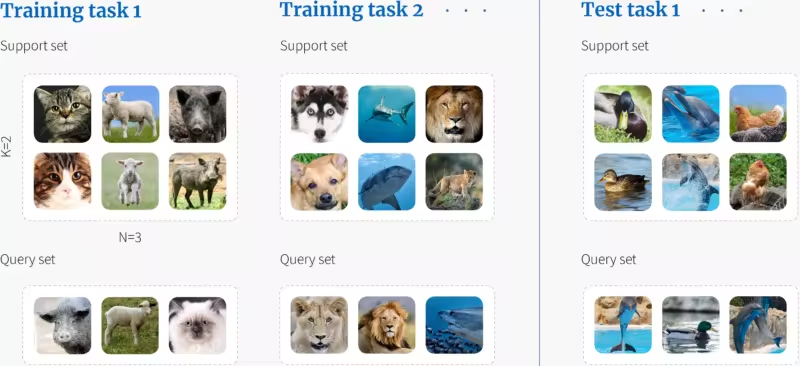

小样本学习(FSL)可以被认为是一个元学习问题,在这个问题上,模型会学习如何学习解决给定的问题。

让我们以一个图像分类问题为例:

小样板学习的目的是让ML模型在训练数据集中有少量实例的情况下预测出正确的类别。零样本学习的目的是预测正确的类别,而不需要在训练数据集中接触任何属于该类别的实例。零样本学习和小样本学习有相互的应用,例如:

最后是单次学习,它经常与零样本学习混在一起。单次学习是一种特殊的小样本学习问题,其目的是从一个训练样本/图像中学习有关物体类别的信息。智能手机使用的人脸识别技术就是一个单次学习问题的例子。

关于相似性的先验知识:ML模型在训练数据中学习模式,这些模式倾向于分离不同的类别,即使它们是未见过的。传统的ML模型不能区分训练数据集中不存在的类,而小样本学习技术使ML模型能够区分训练数据中不存在的两个类,在某些应用中,它们甚至可以区分两个以上的未见过的类:

辨别两个未见过的类别:

辨别多个未见过的类别:

关于学习的先验知识:ML模型使用先验知识来约束学习算法,以选择能从少数例子中很好概括的参数。

在小样本学习中用于超参数调整的技术有:

学习更新规则也可以鼓励小数据集的良好表现:

序列方法取整个数据集和测试实例,预测测试标签的值:

数据的先验知识:ML模型利用关于数据结构和变异性的先验知识,这使得从少数例子中构建可行的模型。

生成模型可以为数据类别的家族构建:

训练集的新例子可以被合成:

目前有几个开源的几率学习项目。为了实现小样本学习项目,用户可以参考以下Python中的库/存储库:

的研究表明,ML在未来将围绕以下几个部分进行发展:

全部评论

留言在赶来的路上...

发表评论