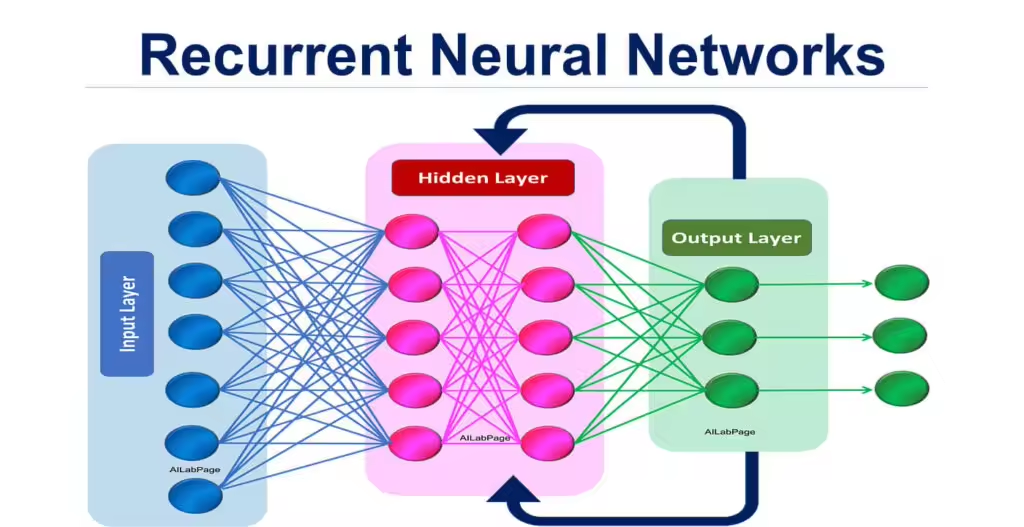

更多信息,你可以查看的文章。RNNs是这些常规神经网络的扩展。

RNNs及其变体LSTMs和GRU被用于输入数据具有顺序性的问题中。有顺序数据的应用包括:

递归神经网络存在一个叫做的问题,这也是其他神经网络算法的普遍问题。梯度消失问题是一种叫做的算法的结果,该算法允许神经网络优化学习过程。

简而言之,神经网络模型比较其输出和所需输出之间的差异,并将这一信息反馈给网络,使用一个称为梯度的值来调整参数,如权重。梯度值越大,意味着对参数的调整越大,反之亦然。这个过程一直持续到达到令人满意的精度水平。

RNNs利用通过时间的反向传播(BPTT)算法,其计算结果取决于以前的步骤。然而,如果在反向传播过程中某一步的梯度值太小,那么下一步的值就会更小。这导致梯度以指数形式减少,达到模型停止学习的程度。

这被称为梯度消失问题,并导致RNN有一个短期记忆:早期的输出对当前的输出影响越来越小或没有影响。这可以从上面的 “现在是什么时候?”问题中看出,随着模型在句子中的移动,早期单词的颜色会缩小。

梯度消失的问题可以通过不同的RNN变体来补救。其中两个被称为(LSTM)和(GRU)。这些算法使用被称为 “门 “的机制来控制保留和遗忘多少信息以及哪些信息。

全部评论

留言在赶来的路上...

发表评论