想在 Mac 上直接运行生成式人工智能?这就是 的用武之地。但有一个问题–现代 LLM 每个可能占用 4GB 到 40GB,很快就会占满你的内置硬盘。

默认情况下,Ollama 会将所有内容存储在 Mac 内置硬盘上的 ~/.ollama 文件夹中。让我们把它移到外置硬盘上:

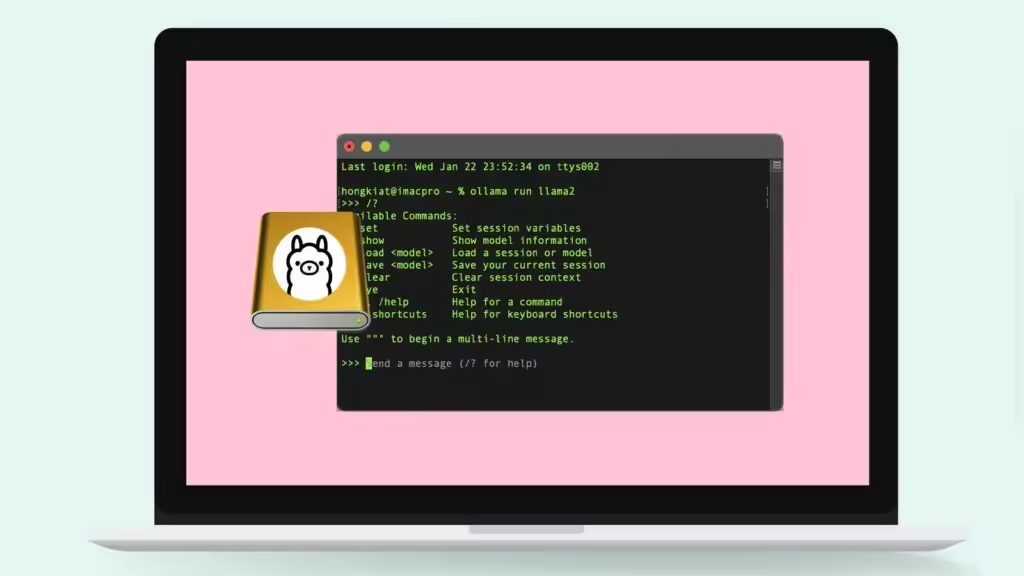

是时候运行你的第一个 LLM 了!打开终端,然后

就是这样!现在你就可以通过 Ollama 与 Llama 2 聊天了,白度白读百度baidu09一切都在你的外置硬盘上运行。

所有文件都存储在 /Volumes/YourDriveName/.ollama 文件夹中。模型在 models/blobs 子文件夹中。

在终端中键入 ls /Volumes/YourDriveName/.ollama/models/blobs/ 查看所有下载的模型。

由于我们是通过 Homebrew 安装的,因此只需运行

然后删除外置硬盘中的 .ollama 文件夹。

在 查找更多可以下载的 LLM,然后使用 pull 命令:

例如:ollama pull deepseek-r1 或 ollama pull llama3.3

运行此命令:

这将显示所有已安装的模型及其大小。

使用删除命令:

例如:ollama rm llama2

可以。按照上述步骤在另一台 Mac 上安装 Ollama,白度白读百度baidu09然后创建指向外置硬盘.ollama 文件夹的符号链接并连接外置硬盘。您的模型无需再次下载即可使用。

全部评论

留言在赶来的路上...

发表评论