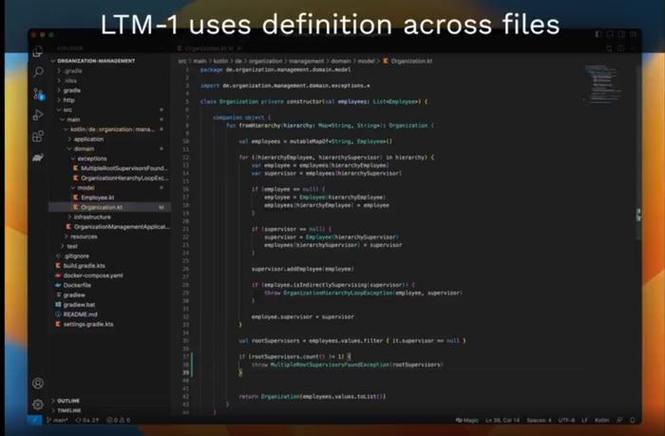

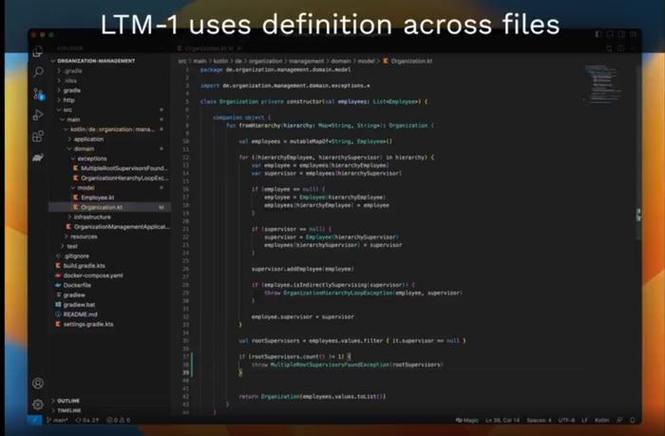

LTM-2-mini是Magic公司推出的支持1亿token上下文AI模型,能处理相当于1000万行代码或750本小说的内容。LTM-2-mini采用序列维度算法,计算效率比Llama 3.1 405B的注意力机制高出约1000倍,能够处理大规模代码库和相关文档,生成高质量代码,有望改变AI模型的运作方式。为了评估和优化模型的上下文处理能力,Magic团队设计了新的评估体系HashHop,通过多跳、无语义提示和无新近性偏差的方式,更准确地评估模型的性能。

LTM-2-mini是Magic公司推出的支持1亿token上下文AI模型,能处理相当于1000万行代码或750本小说的内容。LTM-2-mini采用序列维度算法,计算效率比Llama 3.1 405B的注意力机制高出约1000倍,能够处理大规模代码库和相关文档,生成高质量代码,有望改变AI模型的运作方式。为了评估和优化模型的上下文处理能力,Magic团队设计了新的评估体系HashHop,通过多跳、无语义提示和无新近性偏差的方式,更准确地评估模型的性能。

全部评论

留言在赶来的路上...

发表评论