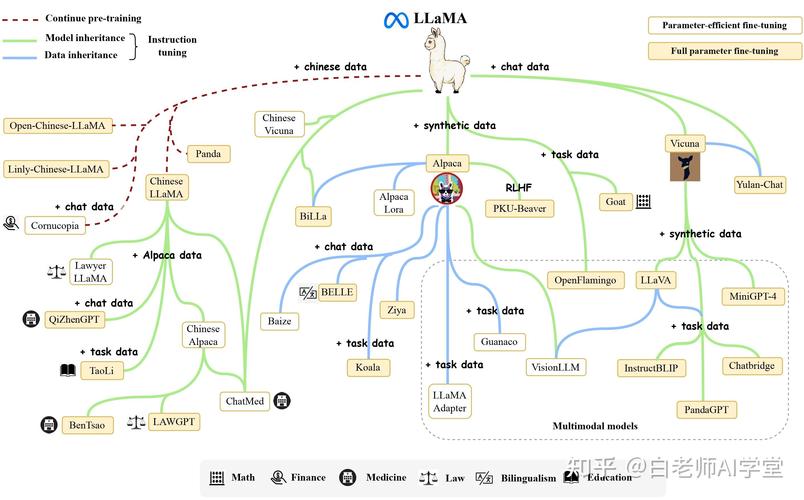

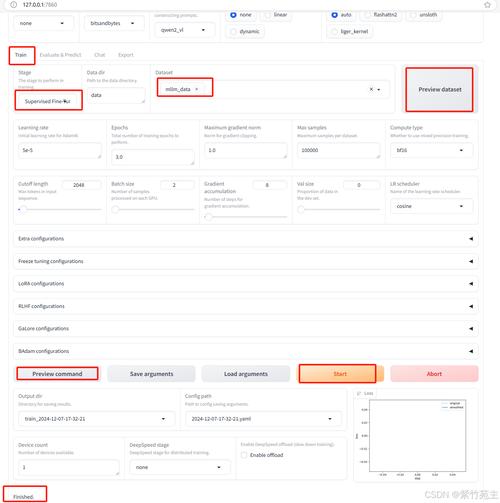

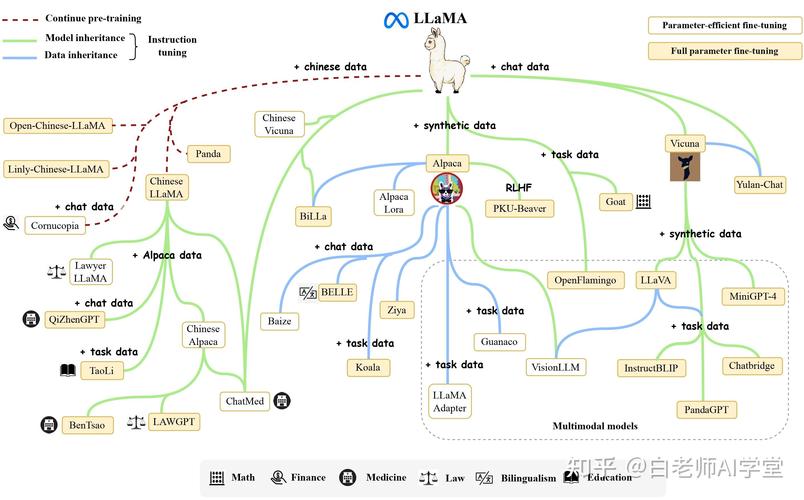

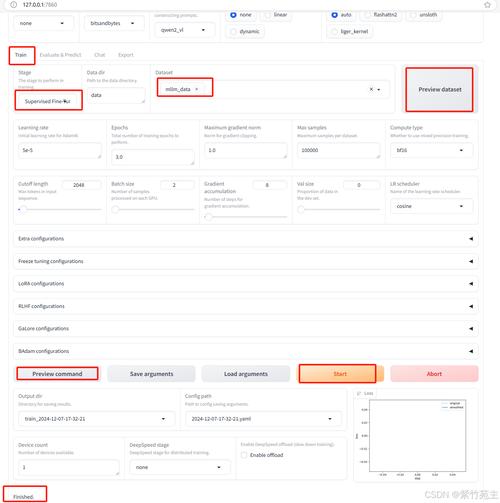

Mini-LLaVA是一款轻量级的多模态大语言模型,由清华大学和北京航空航天大学的研究团队联合开发。能处理图像、文本和视频输入,实现高效的多模态数据处理。Mini-LLaVA基于Llama 3.1模型,优化了代码结构,在单个GPU上即可运行,适合复杂的视觉-文本关联任务。项目已在GitHub上开源,便于研究者和开发者下载使用。Mini-LLaVA的设计注重代码的可读性和功能的扩展性,支持定制和微调,适应不同的应用场景。

Mini-LLaVA是一款轻量级的多模态大语言模型,由清华大学和北京航空航天大学的研究团队联合开发。能处理图像、文本和视频输入,实现高效的多模态数据处理。Mini-LLaVA基于Llama 3.1模型,优化了代码结构,在单个GPU上即可运行,适合复杂的视觉-文本关联任务。项目已在GitHub上开源,便于研究者和开发者下载使用。Mini-LLaVA的设计注重代码的可读性和功能的扩展性,支持定制和微调,适应不同的应用场景。

全部评论

留言在赶来的路上...

发表评论