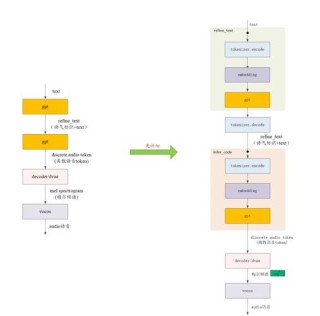

Motion Dreamer是香港科技大学(广州)研究者提出的框架,生成运动合理视频。基于两阶段生成方式,先基于输入图像和运动条件生成中间运动表示,再利用该表示生成高细节视频。其引入实例流这一新运动模态,可实现从稀疏到密集的运动控制,用户通过提供稀疏运动提示,模型能生成时间连贯视频。训练时采用随机掩码实例流策略,提升模型推理能力和泛化能力。在Physion数据集及自动驾驶数据集上的实验表明,Motion Dreamer在运动连贯性和物理合理性方面显著优于其他模型,同时生成高质量视频。

(图片来源网络,侵删)

(图片来源网络,侵删)

全部评论

留言在赶来的路上...

发表评论