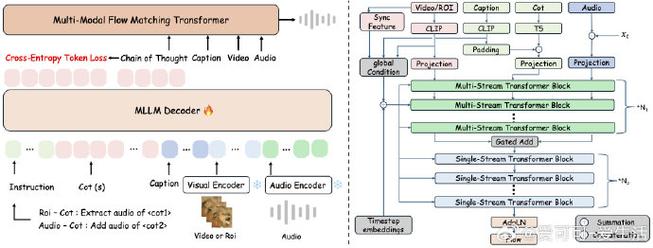

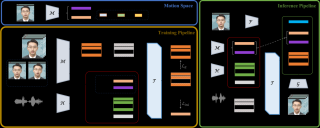

MultiTalk 是中山大学深圳校区、美团和香港科技大学联合推出的新型音频驱动多人对话框架。框架根据多声道音频输入、参考图像和文本提示,生成包含人物互动且口型与音频一致的视频。框架推出 Label Rotary Position Embedding (L-RoPE) 方法,有效解决多声道音频与人物绑定的问题,借助部分参数训练和多任务训练策略,保留基础模型的指令跟随能力。MultiTalk 在多个数据集上表现出色,展示了强大的视频生成能力,适用生成卡通、歌唱及遵循指令的视频等多种场景。

(图片来源网络,侵删)

(图片来源网络,侵删)

全部评论

留言在赶来的路上...

发表评论