编程语言是任何 AI 项目的基础。它定义了项目的生态系统,也有助于确定我们将在项目中使用的库。一些编程语言,例如 Python 和 JavaScript,提供了大量用于开发 AI 应用程序的库。Python 和 JavaScript 是关键的选择。

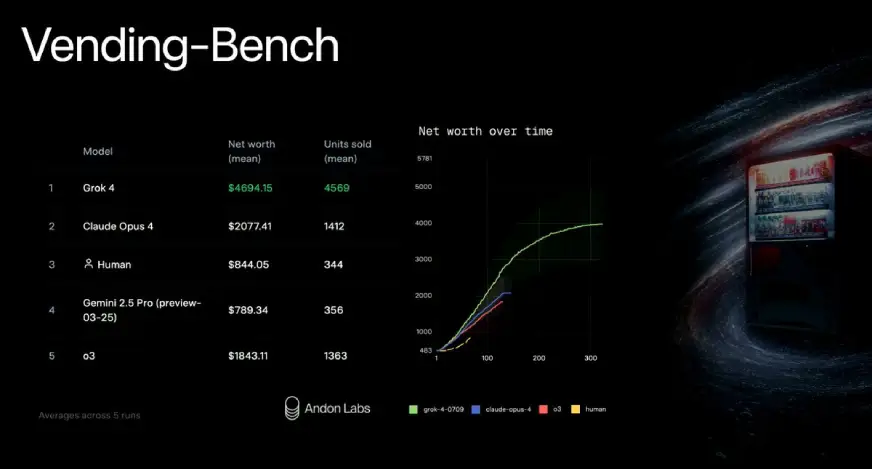

大型语言模型 (LLM) 就像 AI 应用程序的大脑。这些 LLM 可以通过思考用户查询来有效地回答问题。将这些 LLM 集成到您的 AI 应用程序中,可以赋予您的应用程序超能力,使其能够进行思考并做出相应的决策,而无需对 if-else 条件进行硬编码。

如果您不想将您的个人数据暴露给 AI 公司,一些平台提供本地系统的自托管功能。这种方式可以确保更好的控制、隐私以及成本节省。OpenLLM、Ollama 和 vLLM 等平台提供了大量可托管在本地系统的开源 LLM。自托管开源 LLM 的主要平台包括:

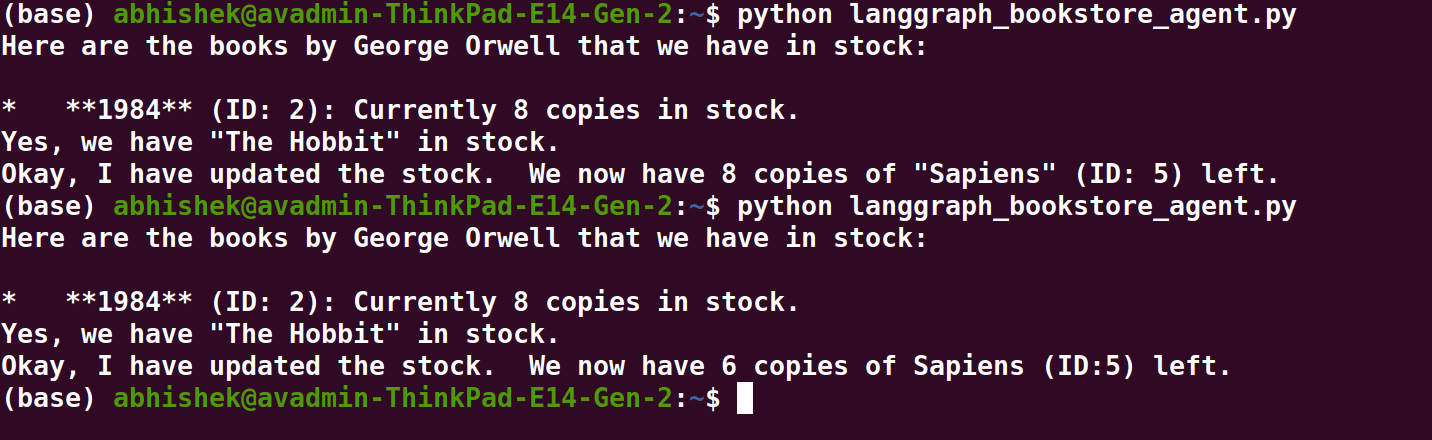

您已经定义了所选工具、不同的 LLM 和框架,但现在需要了解如何将它们组合在一起。答案是编排框架。这些框架广泛用于在 AI 应用程序中组合工具的不同元素。用例包括链接提示、内存实现和工作流中的检索。一些框架包括:

现代人工智能应用需要特殊类型的数据库来存储数据。过去,应用程序数据通常以表或对象的形式存储。如今,存储方式发生了变化,人工智能应用需要存储高密度向量,这需要像向量数据库这样特殊类型的数据库。这些数据库以优化的方式存储向量,使搜索或相似性搜索尽可能流畅。它能够实现平滑的检索增强生成 (RAG)。一些向量数据库包括:

AI 应用程序需要一个前端来支持用户与其组件交互。Python 中有一些框架只需极少的代码,您的前端几分钟即可准备就绪。这些框架易于学习,使用时具有很大的灵活性。它允许用户以可视化的方式与 AI 模型交互。一些框架包括:

机器学习操作 (MLOps) 是构建 AI 应用的高级概念。生产级应用程序需要模型生命周期和监控数据。MLOps 负责协调整个机器学习生命周期,从开发、版本控制到性能监控。它在 AI 应用开发和部署之间架起了一座桥梁。有一些工具可以简化这些流程。核心工具和平台:

本指南帮助您选择合适的工具来有效地构建 AI 应用。像 Python 这样的编程语言通过定义应用程序的逻辑和生态系统构成了基础。 LLM 和 API 通过支持推理和内容生成来提升智能,而自托管模型则提供更强的控制力和隐私保护。LangChain 和 AutoGen 等编排框架有助于链接提示、管理内存和集成工具。Pinecone、FAISS 和 ChromaDB 等矢量数据库支持快速语义搜索和强大的检索增强生成功能。Streamlit 和 Gradio 等 UI 工具可以轻松构建用户友好的界面,而 MLflow 和 Kubernetes 等 MLOps 平台则可以管理部署、监控和扩展。

借助此工具包,构建智能应用程序比以往任何时候都更容易,您只需一个想法和几行代码,就能实现下一个 AI 驱动的突破。

问 1:我需要全部 7 个工具才能开始吗?

答:不,最初无需采用所有工具。您可以从最低配置开始,例如 Python、OpenAI API 和 Gradio,以快速构建原型。随着应用程序复杂度或使用量的增加,您可以逐步整合向量数据库、编排框架和 MLOps 工具,以提高稳健性和性能。

问题 2:为什么选择自托管而不是基于 API 的使用?

答:自托管可以更好地控制数据隐私、延迟和自定义。虽然 API 方便进行快速实验,但在本地或本地托管模型在规模化方面更具成本效益,并且允许进行微调、增强安全性和离线功能。

问题 3:像 LangChain 这样的编排框架是否必要?

答:虽然编排框架对于简单任务并非必需,但对于涉及提示链接、内存处理、工具使用和检索增强生成 (RAG) 的多步骤工作流来说非常有益。它们抽象了复杂的逻辑,并支持更模块化、更易于维护的 AI 流水线。

问题 4:我可以在不使用云平台的情况下进行部署吗?

答:是的,您可以在本地服务器、边缘设备或像 DigitalOcean 这样的轻量级平台上部署 AI 应用。使用 Docker 或类似的容器化工具,您的应用程序可以安全高效地运行,而无需依赖主流云服务提供商。

问 5:如何在生产环境中监控和管理模型性能?

答:MLflow、Fiddler 或 Prometheus 等 MLOps 工具可以帮助您跟踪模型使用情况、检测数据漂移、监控响应延迟并记录错误。这些工具可确保可靠性,并帮助您做出有关重新训练或扩展模型的明智决策。

全部评论

留言在赶来的路上...

发表评论