研究人员测试了多种 LLM:

这个现代化版本忠实于图灵的结构,同时更新了参与者和语境,以适应当今的人工智能对话环境。

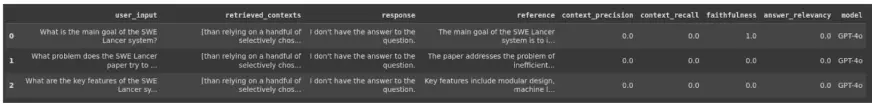

测试中最有趣的结果是 OpenAI 的 GPT-4.5 在给定一个精心设计的角色时,有 54% 到 73% 的时间都能骗过人类评委。在一些试验中,参与者更愿意相信人工智能是人类,而不是真正的人类受访者。这不仅仅是统计上的噪音,而是不同实验条件和参与者群体之间的一致模式。研究人员测试了五个领先的法律硕士和一个对照组,以下是他们的结果:

更有趣的是,不同用户群体的结果各不相同:

这表明,即使是知情用户也很难分辨出机器和人类。

让 GPT-4.5 如此令人信服的并不是原始的语言能力。而是它在社交和情感参数上的表现。

研究人员发现,当为 GPT-4.5 设定一个“角色”时,它突然变得更像人类了。 一层微妙的叙事让它有了足够的瑕疵和怪癖,从而唤起了人们的共鸣。参与者表示,当模型出现小错误、表达不确定性或使用俚语或缩写等随意语言时,“感觉更自然”。

相比之下,其他过于正式或语法完美的模型则很容易被发现是机器人。

这些发现强调了一个重大转变:LLM 不需要完美到可以冒充人类,他们只需要不完美到令人信服的程度。可信度不在于事实的准确性,而在于情感和对话的共鸣。GPT-4.5 赢得比赛并不是因为它更聪明,而是因为它能准确地模拟人类的含义。

如果 LLM 现在可以假装比真人更会做人,那我们就不再只是在玩游戏了。我们正在应对数字空间中人格定义方式的根本性转变。

哲学家丹尼尔-丹尼特(Daniel Dennett)在一篇文章中对“伪造的 ”发出了警告–。这篇论文表明,我们现在已经达到了这一境界。

具有讽刺意味的是,通过图灵测试的机器人并不是那些完美无缺的机器人,而是那些在各方面都不完美的机器人。那些偶尔犹豫着要不要问清楚问题,或者使用 “我不确定 ”等自然填充短语的机器人,比那些以精炼、百科全书式的精确度回答问题的机器人更有人性。

这说明了一个奇怪的事实:在我们眼中,人性是在夹缝中发现的–在不确定性、情感表达、幽默甚至尴尬中。这些都是真实和社会存在的标志。而现在,LLM 已经学会了模拟它们。

那么,当机器不仅能模仿我们的优点,还能模仿我们的弱点时,会发生什么呢?如果人工智能能如此令人信服地模仿我们的疑虑、怪癖和说话语气,那么还有什么能让我们成为独一无二的人类呢?那么,图灵测试就成了一面镜子。我们用机器做不到的事来定义人类,但这条线正变得越来越薄,非常危险。

随着 LLM 开始令人信服地仿真人类,各种现实世界的应用成为可能:

这些只是众多可能性中的一部分。随着人工智能与人类之间的界限逐渐模糊,我们可以预见一个生物数字世界的崛起。

GPT-4.5 通过了图灵测试。但对我们来说,真正的考验才刚刚开始。在一个机器与人无法区分的世界里,我们该如何保护真实性?我们如何保护我们自己?在数字空间中,我们还能相信自己的直觉吗?

这篇论文不仅仅是一个研究里程碑。它是一个文化里程碑。它告诉我们,人工智能不只是在追赶,而是在融入。模拟与现实之间的界限越来越模糊。我们现在生活在一个机器比人更像人的世界里,至少在聊天室里的五分钟是这样。问题不再是“机器能思考吗?” 而是:我们还能分辨出谁在思考吗?

全部评论

留言在赶来的路上...

发表评论