研究发现:在比较各种指标的研究中,METEOR 与人类判断的相关系数通常在 0.60-0.75 之间,优于通常在 0.45-0.60 之间的 BLEU。

使用 Python 中的 NLTK 库实现 METEOR 非常简单:

下面我们将首先安装所有需要的库。

接下来,我们将下载所需的 NLTK 资源。

下面是一个综合示例,说明如何用 Python 计算 METEOR 分数:

输出示例:

对你的挑战:尝试以各种方式修改假设,看看 METEOR 分数如何变化。如果用同义词替换单词会怎样?如果完全重新排列词序会怎样?

与其他指标相比,METEOR 有以下几个优势:

最适合:语义等同比精确措辞更重要的复杂评估场景。

尽管 METEOR 有很多优点,但它也有一些局限性:

考虑这一点:在评估专业技术内容时,除非辅以专业词典,否则 METEOR 可能无法识别特定领域的对等词。

METEOR 适用于各种自然语言处理任务:

真实世界实例:WMT(机器翻译研讨会)竞赛将 METEOR 作为其官方评估指标之一,对商业翻译系统的开发产生了影响。

让我们将 METEOR 与其他流行的评估指标进行比较:

在评价创意文本时,如果有多种有效的方法来表达相同的意思,并且有参考文本,则选择 METEOR。

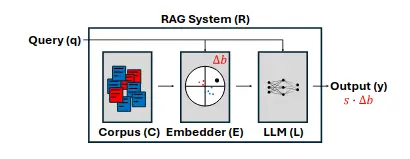

METEOR 解决了许多简单指标的局限性,是自然语言生成评估领域的一大进步。METEOR 能够识别语义相似性、考虑词序以及平衡精确度和召回率,这使得它在评估 LLM 输出时特别有价值,因为在这种情况下,精确的词匹配比保留意义更重要。

随着语言模型的不断发展,像 METEOR 这样的评估指标将在指导其开发和评估其性能方面发挥至关重要的作用。虽然 METEOR 并不完美,但它的评估方法与人类判断文本质量的方法非常吻合,因此成为 NLP 从业人员工具包中的重要工具。

对于语义等同比精确措辞更重要的任务,METEOR 提供了比简单的基于 n-gram 的指标更细致入微的评估,帮助研究人员和开发人员创建更自然、更有效的语言生成系统。

Q1. 什么是 NLP 中的 METEOR?

A. METEOR(Metric for Evaluation of Translation with Explicit ORdering)是一种评估指标,旨在通过考虑词序、词干、同义词和意译来评估机器生成文本的质量。

Q2. METEOR 与 BLEU 有何不同?

A. BLEU 依赖于精确的单词匹配和 n-grams,而 METEOR 则不同,它通过识别同义词、词干和意译,将语义理解纳入其中,使其更符合人类的评价。

Q3. 为什么 METEOR 更适合评估人工智能生成的文本?

A. METEOR 通过惩罚不正确的单词排序和奖励语义相似性来考虑流畅性、连贯性和意义保持,使其成为一种比简单度量更接近人类的评估方法。

Q4. METEOR 能否用于机器翻译以外的任务?

A. 可以,METEOR 广泛用于评估摘要、聊天机器人回复、转述、图像字幕和其他自然语言生成任务。

Q5. METEOR 是否适用于多个参考文本?

A. 是的,METEOR 可以根据多个参考文献对候选文本进行评估,通过考虑同一观点的不同有效表达方式来提高评估的准确性。

全部评论

留言在赶来的路上...

发表评论