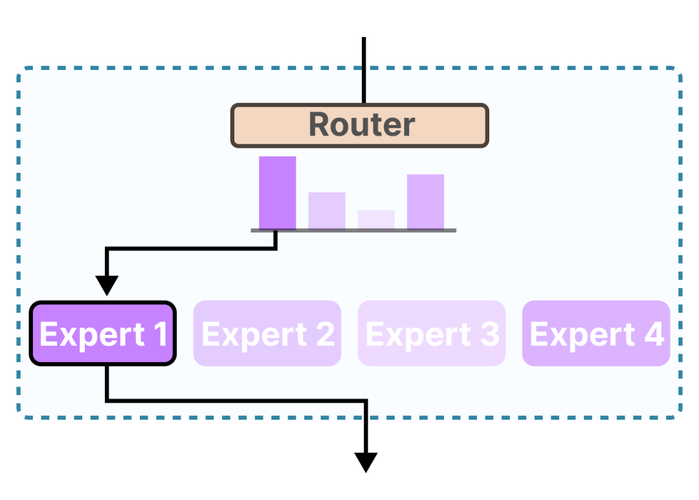

MoE++是一种新型的混合专家(Mixture-of-Experts)架构,由昆仑万维2050研究院与北大袁粒团队联合推出。基于引入零计算量专家,零专家、复制专家和常数专家,降低计算成本、提升模型性能。MoE++支持每个Token动态地与不同数量的前馈网络专家交互,甚至跳过某些层,优化计算资源分配。MoE++基于门控残差帮助Token在选择专家时考虑前一层的路由路径,实现更稳定的路由。实验表明,MoE++在相同模型大小下比传统MoE模型性能更优,专家吞吐速度提升1.1到2.1倍,且易于部署。

(图片来源网络,侵删)

(图片来源网络,侵删)

全部评论

留言在赶来的路上...

发表评论