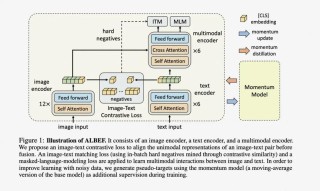

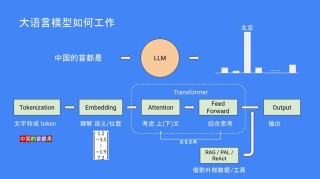

ModernBERT是Answer.AI、LightOn、约翰斯·霍普金斯大学、英伟达和HuggingFace联合推出的现代编码器-only Transformer模型,是对经典BERT模型的一次重大升级。ModernBERT在2万亿token的大规模数据上训练,支持长达8192 token的序列长度,显著提升处理长上下文的能力。ModernBERT在多种自然语言处理任务上性能赶超SOTA,同时速度是DeBERTa的两倍,特别适合信息检索、文本分类和实体识别等应用。模型现已开源,供学术界和工业界研究和应用。

全部评论

留言在赶来的路上...

发表评论