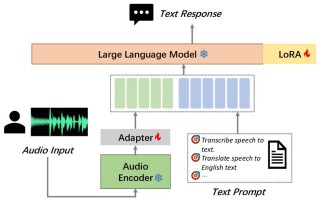

MeteoRA 是南京大学计算机科学与技术系的研究团队推出的用于大型语言模型(LLM)的多任务嵌入框架,将多个任务特定的 LoRA(低秩适配器)集成到一个基础模型中,实现高效的参数复用和自主任务切换。MeteoRA基于混合专家(MoE)架构,用可训练的门控网络动态选择最适合当前输入的 LoRA 适配器,无需显式任务指令。MeteoRA 提出 MoE 前向加速策略,基于自定义 GPU 核算子显著提升了推理效率,同时保持低内存开销。在实验中,MeteoRA 在多种任务上展现出与传统微调方法相当的性能,在复合任务中表现出色,支持在一个推理过程中解决多个子问题。

全部评论

留言在赶来的路上...

发表评论